Claude Code 是 Anthropic 出品的 AI 编码代理,在终端中读取代码、编辑文件、运行命令。Documentation Index

Fetch the complete documentation index at: https://docs.ruoli.dev/llms.txt

Use this file to discover all available pages before exploring further.

安装

使用 CC Switch 配置(推荐)

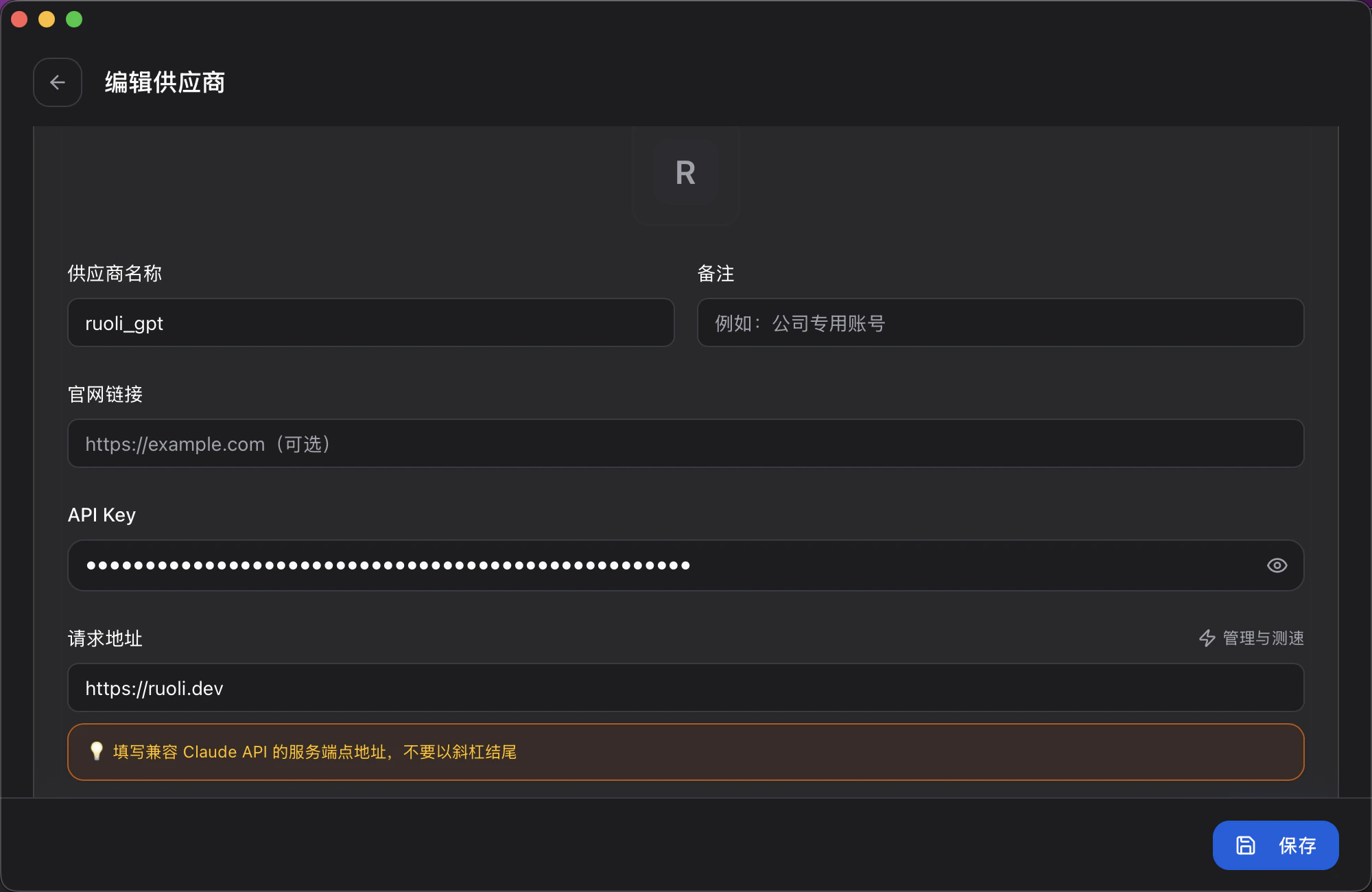

打开 CC Switch,选择顶部 Claude 标签,点击 + 添加配置:

| 字段 | 填写内容 |

|---|---|

| 供应商名称 | 自定义,如 ruoli_claude |

| API Key | 你的 Key |

| 请求地址 | https://ruoli.dev |

切换模型

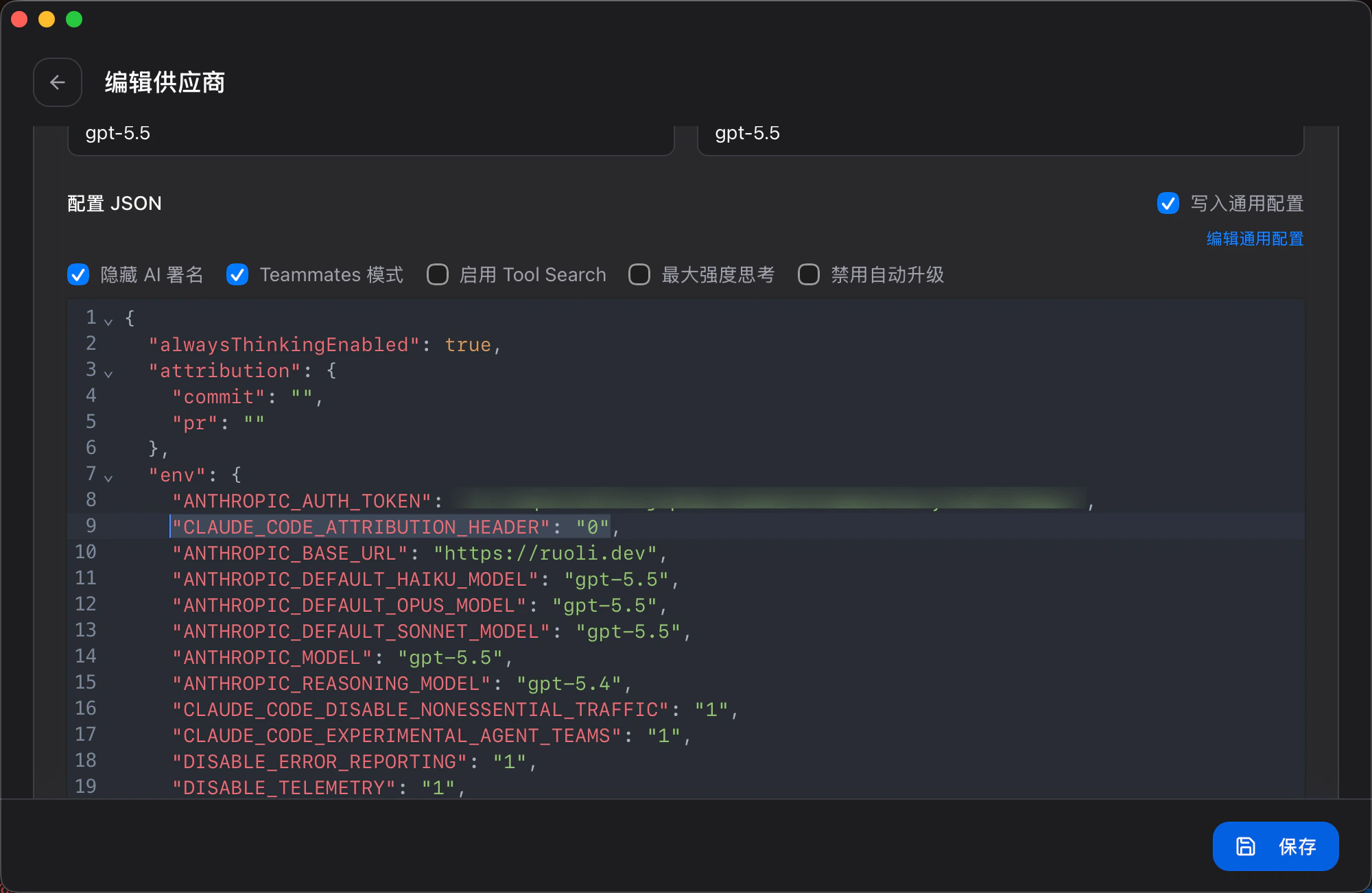

除了 Claude 原生模型,RuoLi 还接入了gpt-5.5、GLM、Kimi、DeepSeek 等第三方模型。在 CC Switch 打开「编辑供应商 → 模型映射」,把 Claude 的别名指向你想用的模型,保存即可生效,无需改 JSON。

| 字段 | 作用 |

|---|---|

| 主模型 | Claude Code 默认调用的模型 |

| 推理模型 (Thinking) | 开启深度思考 / Reasoning 时使用的模型 |

| Haiku 默认模型 | haiku 别名对应的目标模型 |

| Sonnet 默认模型 | sonnet 别名对应的目标模型 |

| Opus 默认模型 | opus 别名对应的目标模型 |

如果供应商原生就是 Claude 模型,这几项可留空 —— 仅在需要把别名指向其他模型时填写。

关闭归属 Header

在 CC Switch「编辑供应商 → 配置 JSON」的env 里加一行:

~/.claude/settings.json 时同理,见下方示例。

手动配置

编辑~/.claude/settings.json:

配置上下文压缩

Claude Code 默认在上下文窗口使用约 83% 时自动压缩。如果你使用 1M 上下文窗口,可以通过CLAUDE_AUTOCOMPACT_PCT_OVERRIDE 调整压缩触发时机。

例如,希望在 180k tokens 时触发压缩(180k / 1000k = 18%):

在 ~/.claude/settings.json 的 env 中添加:

| 值 | 1M 窗口下触发时机 | 适合场景 |

|---|---|---|

18 | ~180k tokens | 频繁保持干净上下文 |

50 | ~500k tokens | 平衡性能和上下文保留 |

83 | ~830k tokens(默认) | 最大化上下文利用 |

官方文档:code.claude.com/docs